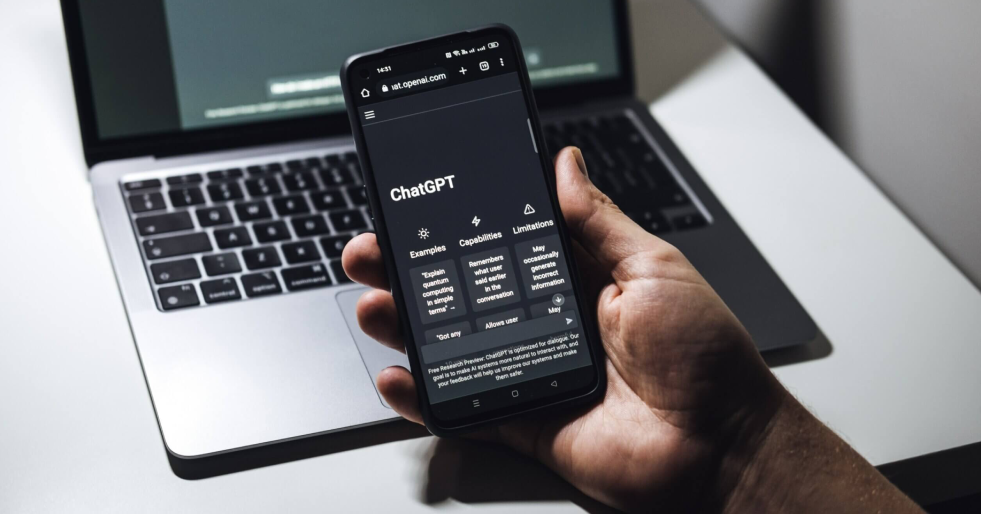

Com a popularização da inteligência artificial (IA), muitas pessoas passaram a procurar diagnósticos para sintomas diretamente em chats inteligentes. Antes, o famoso “doutor Google” era o primeiro recurso. Porém, atualmente as ferramentas de IA parecem ainda mais confiáveis: oferecem explicações bem formuladas, linguagem acessível e, em algumas situações, até apresentam bons índices de acerto em tarefas específicas.

Apesar disso, especialistas alertam que confiar cegamente nesses diagnósticos pode trazer riscos sérios. A prática médica envolve muito mais do que uma resposta automatizada: é preciso considerar a história clínica do paciente, realizar exame físico, solicitar exames complementares e, principalmente, analisar todo o contexto humano.

Quando esses elementos são ignorados, a margem de erro aumenta, principalmente em casos incomuns ou em perguntas muito abertas.

O alerta dos profissionais de saúde

De acordo com o médico emergencista Yuri Castro, da Santa Casa de São Joaquim da Barra (SP), o problema começa na falta de transparência das fontes utilizadas pelos algoritmos:

“O fato de não sabermos qual fonte a IA utilizou para responder ao paciente torna a resposta ainda mais perigosa, visto que existem muitas informações não verdadeiras na internet. Por isso, cada vez mais, é necessário confirmar a origem da informação”, afirma.

A falta de clareza do diagnósticos feitos pelas IA’s pode ter impactos graves: confiar no diagnóstico da IA ao invés de um diagnóstico real, pacientes podem adiar consultas, iniciar tratamentos inadequados ou perder tempo precioso diante de doenças que exigem rapidez no diagnóstico.

Em outras palavras, o uso de IA pode complementar informações, mas jamais substituir a avaliação de um profissional de saúde.

Onde a IA já se destaca, e onde ainda falha

Apesar dos riscos, não se pode ignorar os avanços. Em áreas como radiologia, cardiologia e neurologia, algoritmos de aprendizado profundo atingem altos índices de precisão. Há casos em que superam até médicos experientes, especialmente em tarefas bem delimitadas.

A especialista em inteligência artificial Victoria Luz, de São Paulo, destaca que a tecnologia já alcança resultados expressivos.

“Em diagnósticos complexos, ferramentas baseadas em IA já vão além da eficácia de médicos experientes, alcançando índices de acerto bem mais altos. Áreas como radiologia, onde algoritmos de deep learning atingem mais de 90% de precisão na detecção de nódulos pulmonares, são um exemplo”, explica.

No entanto, Victoria ressalta que os limites permanecem claros.

“Em contextos complexos, a IA falha com frequência. Em perguntas abertas de medicina, por exemplo, menos da metade das respostas geradas por sistemas avançados são realmente corretas”, afirma.

Isso acontece porque situações clínicas não se resumem a imagens ou dados numéricos. Questões sociais, culturais e até hábitos de vida interferem no quadro de saúde e exigem interpretação humana.

Continue lendo:

Uso da Inteligência artificial impacta a formação médica e prática clínica

Microsoft afirma que criou IA quatro 4 vezes melhor que médicos

Como diferenciar soluções seguras de riscos à saúde

Diante do crescimento dessas ferramentas, surge uma dúvida fundamental: como saber se um diagnóstico de IA é realmente confiável? Segundo Victoria Luz, é essencial observar alguns critérios.

“Os três pilares para diferenciar uma solução confiável de algo inadequado são: fonte do conhecimento, propósito do sistema e salvaguardas. Além disso, aprovações regulatórias, estudos clínicos publicados, transparência nos algoritmos e testes em populações diversas são sinais de maior credibilidade”, destaca.

Ferramentas sérias costumam citar suas fontes, deixar claras as limitações e informar quando não têm resposta precisa. Elas funcionam melhor como apoio ao trabalho médico, ajudando na organização de prontuários, na checagem de doses de medicamentos e na triagem de informações.

Por outro lado, usar a IA como substituta do médico continua sendo um risco direto. Yuri Castro reforça o alerta:

“Um diagnóstico ‘errado’ pode implicar atraso no início do tratamento. Portanto, não utilize a IA como substituta do atendimento médico, isso pode prejudicar sua saúde.”

Assim, a inteligência artificial deve ser vista como aliada, mas nunca como substituta da prática médica. O cuidado humano, a escuta atenta e a integração de informações continuam sendo elementos insubstituíveis na preservação da saúde.

Com informações do Metrópoles.