Em um mundo que cada vez mais necessita de soluções rápidas, o uso de ferramentas como Google e chats de Inteligência Artificial (IA) para obter respostas sobre sintomas e medicamentos viraram parte da rotina. Mas, até que ponto o diagnóstico por IA é seguro?

Embora a linguagem pareça clara, formal e segura, nem tudo que é indicado pela IA é realmente confiável. A depender do histórico de pesquisa do usuário e do prompt utilizado, as respostas para determinada condição podem variar.

Isso não quer dizer, no entanto, que a inteligência artificial deva ser deixada de lado. Se você está sentindo algo e não tem condições de visitar um médico naquele momento, o uso do prompt adequado pode te orientar a como lidar. Mas, em hipótese alguma, a consulta com um profissional médico deve ser ignorada.

7 em cada 10 brasileiros utilizam a IA para fins de saúde

Uma pesquisa da plataforma digital de telemedicina “Olá Doutor” buscou entender como os brasileiros utilizam IA no cotidiano quando o assunto é saúde e bem-estar. 71% das 500 pessoas entrevistadas (todas maiores de 18 anos), revelaram recorrer à IA no último ano para tirar dúvidas sobre sintomas ou possíveis doenças.

| DE ACORDO COM OS DADOS, A PESQUISA É MAIS COMUM ENTRE: |

| Usuários do sexo feminino (74,5%) |

| Pessoas com doenças crônicas (81,4%) |

| Estudantes e pessoas de até 30 anos |

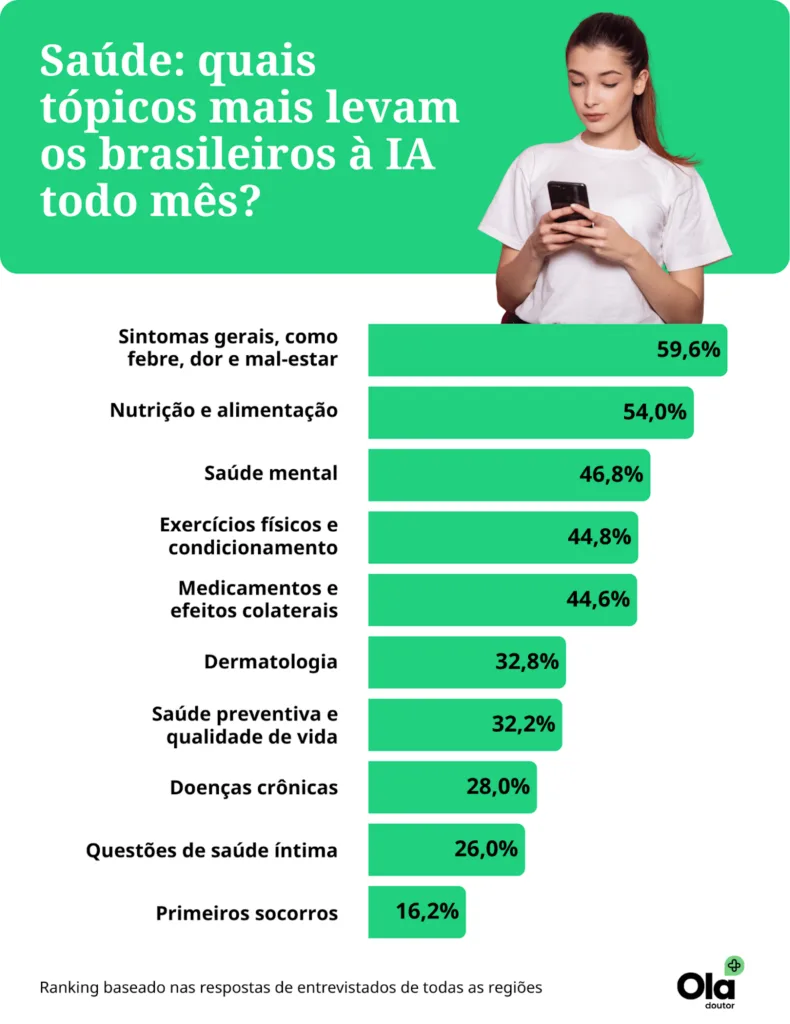

Quanto aos assuntos que mais são pesquisados pelos usuários, o estudo do “Olá Doutor” revelou que os três tópicos mais buscados são, respectivamente: 59,6% sintomas gerais (como febre, dor e mal-estar), 54% nutrição e alimentação e 46,8% questões de saúde mental.

Os problemas do diagnóstico por IA

Com dados de pesquisas anteriores e suspeitas induzidas pelo usuário, a linguagem utilizada pelo chat pode gerar o sentimento de intimidade e segurança. No entanto, confiar 100% na IA não é o indicado.

Por exemplo: sem um conjunto de histórico médico, exame físico e pensamento humano, o diagnóstico buscado para uma dor no peito que aparece junto com náusea pode ser associada à um problema digestivo. Mas, esse também não é um sintoma comum que indica infarto?

Por isso, se o “Dr” não possui dados clínicos do “paciente” ou não faz perguntas essenciais, o diagnóstico tende a ser genérico, assim como o tratamento. E o uso inadequado de um medicamento pode ocasionar em um problema maior no futuro.

Além disso, o próprio usuário pode distorcer o que está sendo dito. De acordo com o estudo, 30,4% deles relataram já ter interpretado um sintoma como mais grave do que realmente era, ao mesmo tempo em que 22,4% minimizaram um sintoma que se mostrou mais sério.

Pesquisa sobre possíveis doenças

Outro problema que pode ser gerado pelo uso de IA sobre saúde é as perguntas frequentes a serem pesquisadas sobre possíveis doenças. Cerca de 20% das pessoas entrevistadas afirmaram ter passado a pesquisar de forma excessiva sobre esses tópicos.

Enquanto isso, com as respostas (ou a falta delas), os usuários tendem a se tornar mais ansiosos quanto à saúde. Das 500 pessoas, 16,8% relataram mais preocupação após recorrer à inteligência artificial.

Exposição de dados pessoais

Além disso, a exposição dos dados acende um alerta para as questões de privacidade. Quem está por trás de um diagnóstico por IA é uma empresa, que embora adote protocolos de segurança, não pode se isentar de riscos.

Uma simples falha ou um vazamento grave pode deixar dados pessoais e clínicos cair em mãos erradas.

Médicos também diagnosticam usando IA

Embora regulamentado pelo CFM, o uso de IA na Medicina devem seguir regras, como a não utilização de diagnóstico ou decisões feitas por IA. O profissional, ainda que use da facilidade e apoio da inteligência artificial, tem contato com histórico clínico, conversa humana com o paciente e exame físico para realizar o diagnóstico.

Na prática, isso significa que a IA pode ampliar a capacidade de análise e auxiliar na organização das informações, mas não substitui o julgamento clínico. Na Medicina, a responsabilidade pelo diagnóstico continua sendo humana.

IA é auxilio, não decisão

A tecnologia pode ser uma aliada importante na democratização do acesso à informação em saúde. No entanto, quando se trata de diagnóstico médico, ela ainda não substitui o olhar clínico e a experiência de um profissional.

Quando a IA pode ajudar na saúde (de forma segura)

O uso da IA pode ser útil em situações clínicas específicas, como na organização de informações, esclarecimento de termos médicos e orientação inicial na busca da consulta, indicando quais são os profissionais mais perto de você e com a melhor avaliação de mercado.

Ferramentas como Google e plataformas de IA podem ajudar o usuário a entender melhor sintomas comuns, desde que utilizadas com senso crítico e sem substituir a avaliação profissional.

📲 As principais notícias do dia na sua caixa de entrada! Se inscreva na Newsletter da MEM